ALGORITMO YOLOV3 MEJORADO para la detección del estado de seguridad del pantógrafo

2022-08-02 09:13Abstracto: El pantógrafo es un componente crítico que conecta el material rodante a la red de suministro eléctrico, por lo que el estado de seguridad del pantógrafo es vital para el funcionamiento fluido y estable del material rodante.

En este documento, mediante el análisis cuadro por cuadro de las imágenes de video del pantógrafo monitoreadas por el sistema de monitoreo de video a bordo, el estado de seguridad del pantógrafo se monitorea en tiempo real mediante la modificación del algoritmo de reconocimiento de objetivos YOLOV3 ampliamente utilizado en la industria para identificar estructuras. anomalías, chispas e intrusión de objetos extraños en el pantógrafo al mismo tiempo. Los experimentos han demostrado que un solo canal puede alcanzar los 40 fps en un servidor de análisis inteligente integrado de Tienuo. La precisión de detección integral mAp@0.5 puede llegar al 98%, logrando resultados de detección en tiempo real y relativamente precisos.

1. Vigilancia inteligente de pantógrafos

Los algoritmos de reconocimiento de objetivos típicos de la actualidad basados en el aprendizaje profundo son algoritmos de dos etapas, como el algoritmo Faster R-CNN, y algoritmos de una etapa, como el algoritmo YOLOV3. El algoritmo YOLO no necesita calcular el cuadro candidato por adelantado en comparación con el algoritmo R- Red CNN, que reduce el esfuerzo computacional y puede lograr una velocidad computacional más rápida. Y el algoritmo YOLOV3 mejora la deficiencia de detección multiescala de la generación anterior del algoritmo YOLO al tener tres ramas en la parte de la red de reconocimiento, que pueden hacer frente al problema del reconocimiento de objetivos en tres escalas: pequeña, mediana y grande. Además, el algoritmo YOLOV3 tiene un mejor soporte de ingeniería y se usa con honor industrial en una gran cantidad de aplicaciones. Por lo tanto, en este trabajo,

2. Construcción del algoritmo de detección del estado de seguridad del pantógrafo

2.1 Abstracción de destino

La detección del estado de seguridad del pantógrafo se puede dividir en detección de anomalías en la estructura del pantógrafo, detección de incendios en el pantógrafo, detección de intrusión de objetos extraños, etc. falta el ángulo de proa derecho, etc. Los estados anormales estándar se muestran en la Figura 1B-F.

Figura 1 Estándares de etiquetado de algoritmos y estado de seguridad del pantógrafo

Para usar el algoritmo de identificación de objetivos, primero es necesario abstraer el objetivo de identificación para detectar el estado de seguridad del pantógrafo, y el objetivo de identificación abstraído se muestra en la Figura 1. Los pantógrafos en estado normal y anormal están etiquetados uniformemente. Los objetivos como el disco de proa y el ángulo de proa en estado normal y el disco de proa y el ángulo de proa en estado anormal y chispas y objetos extraños están marcados. Luego, los datos etiquetados se colocan en un modelo unificado para que el entrenamiento identifique todos los estados de seguridad de los pantógrafos a la vez.

2.2 Mejora de datos de conjuntos de datos basados en redes neuronales GAN

Después de definir el objetivo de detección, necesitamos construir nuestro propio conjunto de datos de estado de seguridad del pantógrafo para aprender las características necesarias del conjunto de datos para los diferentes estados del pantógrafo utilizando métodos de aprendizaje profundo. El conjunto de datos requerido para la construcción del algoritmo en este documento se intercepta a partir de la videovigilancia de pantógrafo para todo clima de varios modelos. Para reducir la influencia del entorno en las características de los datos, las condiciones de trabajo como la iluminación, la oclusión, los días nublados, la lluvia y la nieve, la entrada y la salida, etc., se tienen en cuenta en el proceso de preparación del material de datos. Los estados de falla del pantógrafo en el conjunto de datos también provienen de las imágenes de videovigilancia cuando la falla del pantógrafo ocurre en la forma de funcionamiento principal del tren de motor.

Teniendo en cuenta que algunos tipos de fallas ocurren con menos frecuencia en las condiciones reales de operación, lo que puede resultar en una preparación de datos inadecuada. El desequilibrio entre los datos de categoría tendrá un impacto significativo en el efecto del reconocimiento de objetivos, por lo que este documento adopta un método de mejora de datos basado en redes neuronales GAN para diferentes categorías de datos.

La red adversa generativa GAN contiene dos modelos, un modelo generativo y un modelo discriminativo. La tarea del modelo generativo es generar instancias que se vean naturalmente realistas y similares a los datos originales. La tarea del modelo discriminante es determinar si un ejemplo dado parece ser inherentemente real o artificialmente falso.

Puede verse como un juego de suma cero. El generador trata de engañar al discriminador y el discriminador trata de no ser engañado por el generador. Los modelos se entrenan mediante optimización alternativa y ambos modelos se pueden mejorar. Sobre la base de estas dos redes, la red Generador se utiliza para generar la imagen, que recibe un ruido aleatorio z y provoca la imagen por este ruido, anotado como G(z). El discriminador es una red discriminativa que determina si una imagen es"real"O no. Su entrada es x, x representa una imagen y la salida D(x) representa la probabilidad de que x sea una imagen real. Si es 1, significa una imagen 100% precisa, y si la salida es 0, es imposible que sea una imagen precisa. Luego, la red GAN se muestra esquemáticamente en la Figura 2. x son los datos reales y los datos precisos se ajustan a la distribución Pdata(x). Z son los datos con ruido, y los datos con ruido se ajustan a la distribución Pz(z), como una distribución gaussiana o uniforme. Luego, el muestreo se realiza a partir de la z ruidosa, y los datos x=G(z) se generan después de pasar G. Luego, los datos reales se introducen en el clasificador D, y una función sigmoidea sigue la información generada, y la salida determina la categoría.

Figura 2 Diagrama esquemático del principio de red GAN

La transformación de imagen a imagen es una clase de problemas gráficos y de visión cuyo objetivo es aprender asignaciones entre imágenes de entrada y salida utilizando un conjunto de entrenamiento de pares de imágenes alineadas. Nuestro objetivo es conocer el mapeo G:X → de modo que la distribución de fotografías de G(X) no se pueda distinguir de la distribución Y utilizando la pérdida por adversario. Dado que este mapeo está muy poco restringido, lo combinamos con un mapeo inverso F: Y → e introducimos una pérdida de consistencia cíclica para impulsar F(G(X)) ≈ X (y viceversa). Los resultados cualitativos se proporcionan en varias tareas en las que no existen datos de entrenamiento emparejados, incluida la transformación del método de recopilación, la transformación de objetos, la transformación estacional y la mejora de fotografías. En la medida de lo posible, se seleccionan escenas que son similares o parecidas pero que contienen imágenes de características diferentes. Por ejemplo, en la misma escena, la cámara está sucia y no sucia; la cámara tiene imágenes de lluvia y sin lluvia. A partir de los resultados del entrenamiento, podemos ver que si las dos imágenes seleccionadas son muy diferentes en la ubicación, las otras características incluidas afectarán demasiado el efecto del entrenamiento y la calidad de la generación de imágenes. Y si las imágenes generadas a partir de escenas similares seleccionadas son de calidad aceptable, el impacto de la mejora de datos se muestra en la Figura 3.

Figura 3 Efecto de mejora del conjunto de datos

Además, este documento también adopta un método de sobremuestreo para expandir el conjunto de datos, combinado con la red YOLOV3, viene con medios de mejora de datos, recorte aleatorio de paquetes, volteo aleatorio, transformación de croma y otras operaciones;

Los datos se expanden de manera efectiva para mejorar la adaptabilidad del algoritmo y proporcionar una mayor robustez para detectar objetos en la fase de implementación del uso práctico. Sin embargo, para distinguir entre los ángulos de proa izquierdo y derecho, los interruptores de volteo y rotación aleatorios están desactivados en el algoritmo de este documento.

2.3 Optimización del algoritmo de reconocimiento basado en la red YOLOV3

La parte troncal de YOLOV3 utiliza la estructura Darknet53 del autor, que puede resolver los problemas de desaparición y explosión de gradientes al combinar una red neuronal convolucional (CNN) y una red de estructura residual (ResNet), lo que hace posible el entrenamiento de redes profundas. Además, el algoritmo no necesita calcular las casillas candidatas por adelantado. Aun así, obtiene el BondingBox a priori agrupando, seleccionando 9 clústeres y tres escalas, y distribuyendo estos 9 clústeres uniformemente en estas tres escalas. Sin embargo, debido al problema de la escala, la precisión del algoritmo YOLO no es la mejor entre los algoritmos de reconocimiento de objetivos, especialmente en la detección de objetivos pequeños. Para mejorar la precisión de detección del algoritmo YOLOV3 mientras se mantiene una alta velocidad, se modifica la columna vertebral de YOLOV3. El método específico es agregar el módulo SE de atención del canal a la unidad residual de darknet53. La estructura de la unidad de red residual antes y después de la transformación se muestra en la Figura 4.

Figura 4 Estructura residual del módulo SE antes y después de la modificación

El módulo SE proviene de SENet, que significa Squeeze-and-Excitation Networks, obtuvo el campeonato de competencia de clasificación de ImageNet 2017, es reconocido por su efectividad y facilidad de implementación, y puede cargarse fácilmente en marcos de modelo de red existentes. SENet aprende principalmente el correlación entre canales y filtra la atención de los canales, lo que aumenta ligeramente el cálculo, pero el efecto es mejor. La parte troncal de Darknet tiene un total de 23 unidades de módulos residuales. En este documento, las unidades Res originales se transforman en unidades SE-Res para algunas unidades residuales. Para mejorar la capacidad de detección de la red YOLOV3 para objetivos pequeños y medianos, las unidades residuales que cambiamos también se encuentran en estas dos ramas. La arquitectura de red general de YOLOV3 transformada por el módulo SE se muestra en la Figura 5.

Figura 5 Diagrama de estructura de la red YOLOV3

En la parte de la red de reconocimiento, YOLOV3 se vuelve más potente mediante el muestreo ascendente y la cascada de capas cruzadas para generar tres escalas diferentes de resultados de detección. En la parte del diseño de la función de pérdida, la confianza, la categoría y la posición del objetivo se aprenden de inmediato mediante una función de pérdida de entropía cruzada, y la función de pérdida se muestra en la Ecuación 1.

3. Análisis de resultados experimentales

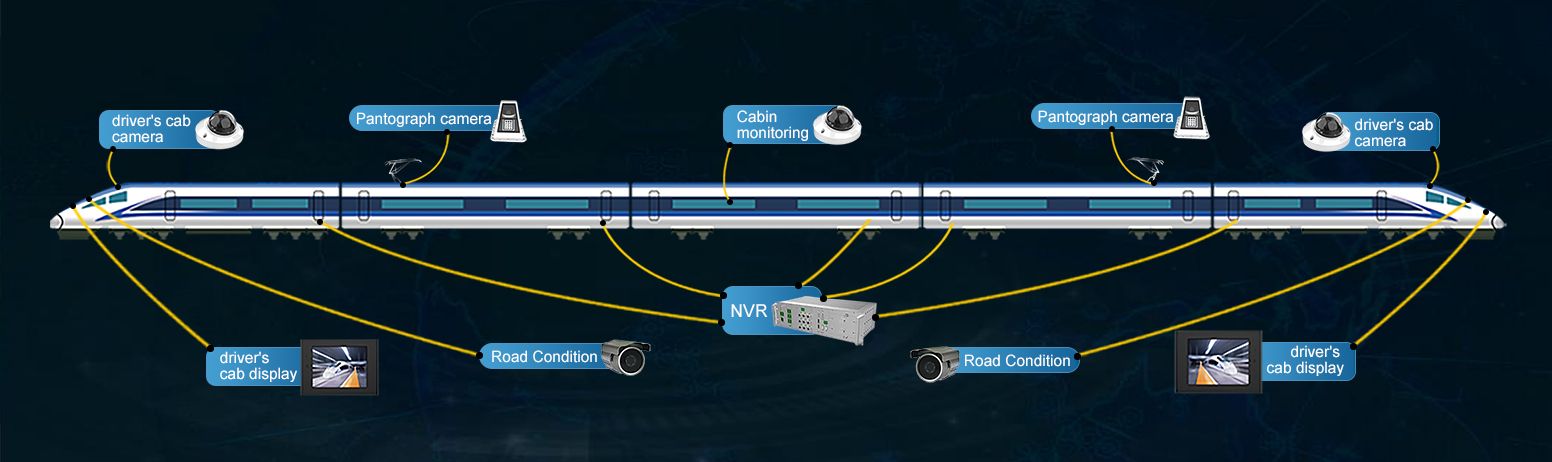

3.1 Introducción del servidor de análisis inteligente de Tienuo

La mayoría de los sistemas de videovigilancia en vehículos existentes solo tienen funciones de monitoreo y almacenamiento de video, pero no tienen la capacidad de análisis inteligente en línea. El hardware de este documento se implementa con la ayuda del servidor de análisis inteligente integrado desarrollado por Shandong Tienuo Intelligent Co., como se muestra en la Figura 6. El host está equipado con el chip inteligente ATLAS 3000 con IA de arquitectura Da Vinci de desarrollo propio de Huawei, que puede haga frente a las aplicaciones de análisis innovadoras en la mayoría de los escenarios y realice las tareas de decodificación y análisis inteligente de hasta 16 canales de video de 720p. Y los resultados de la prueba se pueden transmitir a la cabina del conductor o al mecánico en tiempo real para que los resultados de la prueba se puedan revisar manualmente y se puedan tomar las medidas de seguridad correspondientes. Este documento utiliza este hardware para lograr una velocidad computacional de 60 fps cuando se ejecuta un canal de video de una sola cámara. El análisis simultáneo de 4 canales de múltiples videos también puede garantizar la velocidad de cálculo de 25 fps, lo que puede satisfacer la demanda de análisis inteligente en tiempo real de video multicanal.

Figura 6 Servidor de análisis inteligente y diagrama de interfaz

3.2 Resultados de la identificación del estado del pantógrafo

Para detectar el estado de seguridad de los pantógrafos, este documento construye su propio conjunto de datos de estado de seguridad de pantógrafos, que contiene 2388 imágenes de varias formas de pantógrafos, incluidos pantógrafos en estado normal e imágenes de monitoreo de pantógrafos en estado anormal bajo diferentes condiciones de trabajo. El conjunto de datos etiquetados se entrena utilizando el marco darknet, y el proceso de entrenamiento se muestra en la Figura 7. En la figura se puede ver que la pérdida de entrenamiento permanece estable después de 12000 iteraciones, y el modelo puede caer en un óptimo local. La tasa de aprendizaje se ajusta una vez en 20000 iteraciones y la pérdida cae por debajo de 0,1. La mejora en la precisión computacional a partir de las 20 000 iteraciones no es significativa, y el diagrama mAP correspondiente muestra una ligera pérdida en la capacidad de generalización del modelo. Para considerar la pérdida de entrenamiento y mAP,

Figura 4 Proceso de entrenamiento de identificación del estado de seguridad del pantógrafo

Para implementar el modelo entrenado en el host de análisis inteligente, el modelo entrenado debe convertirse al formato om compatible con la arquitectura da Vinci de Huawei, con una ligera pérdida de precisión en el proceso de conversión, pero todo dentro de un rango aceptable.

4. Resumen y Prospecto

Este documento utiliza el algoritmo YOLOV3 para detectar el estado de seguridad de los pantógrafos, incluidas las anomalías estructurales, las chispas y la intrusión de objetos extraños, a través del monitoreo de video en tiempo real, teniendo en cuenta la velocidad de detección y asegurando que la precisión de la detección cumpla con los requisitos de la realidad. análisis de tiempo Proporciona nuevas ideas para utilizar un sistema de análisis inteligente a bordo en una inspección de seguridad del pantógrafo.